Du sitzt im Lenkungsausschuss. Die Folie zeigt eine Roadmap für KI-gestützte Prozessautomatisierung, sauber in Q3 und Q4 aufgeteilt. Der Berater spricht von Effizienzgewinnen, von Skalierung, von einem „Piloten mit Potenzial“. Die Köpfe nicken. Dann kommt die Folie mit dem Betriebsmodell: Agenten, die eigenständig Workflows steuern, Daten beschaffen, Ergebnisse bewerten und Entscheidungen vorbereiten. Ohne menschliches Zutun zwischen Auftrag und Ergebnis.

Und niemand fragt: Was passiert mit den 340 Beschäftigten, die genau diese Aufgaben heute erledigen?

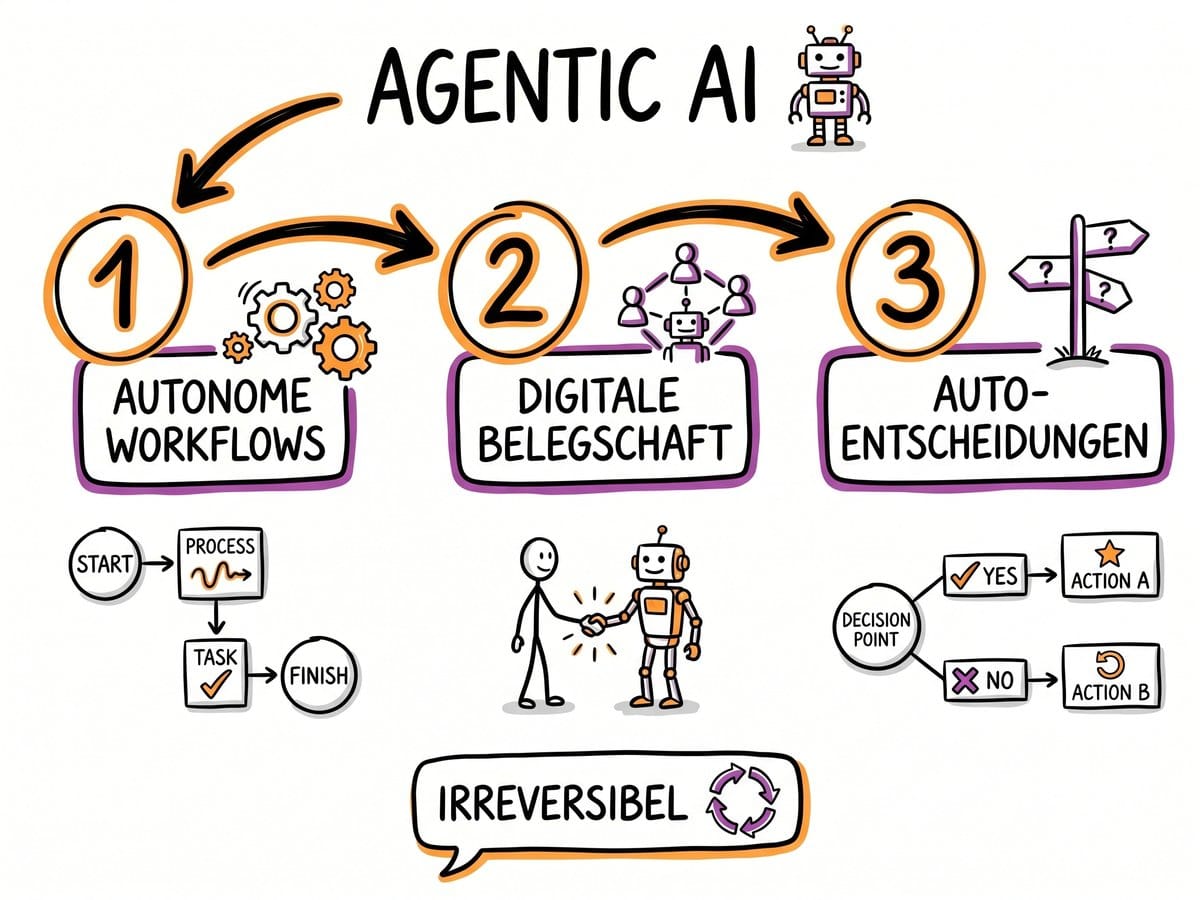

Agentic AI ist kein Upgrade bestehender Chatbots. Es ist kein besseres Sprachmodell mit hübscherer Oberfläche. Es ist eine Architektur, in der KI-Systeme eigenständig planen, Werkzeuge einsetzen, reflektieren und ihre Vorgehensweise anpassen. Das klingt nach Science-Fiction. Ist es nicht. Große Finanzdienstleister automatisieren bereits ihre Kreditprüfung mit autonomen Agenten. Konsumgüterhersteller lassen Marketing-Kampagnen von KI-Systemen orchestrieren, die selbständig Datenquellen anzapfen, Zielgruppen segmentieren und Budgets umschichten.

Die Veränderung, die hier stattfindet, ist nicht inkrementell. Sie ist strukturell und in weiten Teilen irreversibel. Drei Effekte treiben diese Entwicklung, und jeder einzelne verdient einen genaueren Blick.

Wenn der Workflow sich selbst organisiert

Die erste Veränderung betrifft die Art, wie Arbeit organisiert wird. Bisher folgen Geschäftsprozesse einem Muster: Menschen definieren Abläufe, Menschen führen sie aus, Menschen passen sie an, wenn sich Rahmenbedingungen ändern. Agentic AI dreht diese Logik um. Ein Agent erhält ein Ziel, zerlegt es in Teilaufgaben, wählt die passenden Werkzeuge, arbeitet die Schritte ab und korrigiert sich, wenn ein Zwischenergebnis nicht dem erwarteten Muster entspricht.

Das ist kein theoretisches Konstrukt. In der Praxis bedeutet es: Der Agent durchsucht eine Datenbank, bewertet die Ergebnisse gegen definierte Kriterien, ruft bei Bedarf eine zweite Quelle ab und erstellt einen Bericht. Alles in Echtzeit. Alles dynamisch anpassend. Ohne dass ein Mensch die einzelnen Schritte freigeben muss.

Für Führungskräfte ändert sich damit eine Grundannahme. Du steuerst nicht mehr den Prozess. Du steuerst die Zieldefinition und die Leitplanken. Das ist ein fundamentaler Unterschied. Wer bisher über Stellenpläne und Zuständigkeitsmatrix geführt hat, braucht plötzlich ein anderes Instrumentarium. Die Frage ist nicht mehr: Wer macht was? Die Frage lautet: Welche Ergebnisse erwarte ich, und welche Grenzen setze ich?

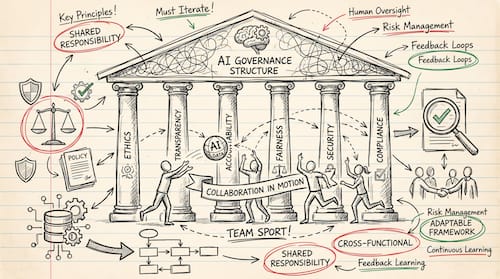

In hochregulierten Umgebungen, wie ich sie lange Jahre kenne, ist das eine besonders heikle Situation. Denn Governance bedeutet hier nicht nur Compliance-Formulare. Es bedeutet: nachvollziehbare Entscheidungsketten, revisionssichere Dokumentation, klare Verantwortlichkeiten. Ein Agent, der sich seinen Weg selbst sucht, muss diese Anforderungen genauso erfüllen wie ein Sachbearbeiter im vierten Stock. Tut er das nicht, entsteht kein Effizienzgewinn. Es entsteht ein Haftungsrisiko.

Technisch basieren diese Agenten auf einem Zusammenspiel dreier Fähigkeiten: Planung, Werkzeugeinsatz und Reflexion. Der Agent plant seinen Lösungsweg, nutzt verfügbare Datenquellen und Schnittstellen, und bewertet sein eigenes Ergebnis gegen das ursprüngliche Ziel. Wenn das Ergebnis nicht passt, plant er um. Das klingt nach einem erfahrenen Projektleiter. Der Unterschied: Der Agent tut das in Sekunden, nicht in Wochen. Und er wird nie müde, nie frustriert, nie politisch. Ob das ein Vorteil ist, hängt vom Kontext ab.

Die neue digitale Belegschaft

Die zweite Veränderung ist unangenehmer. Agentic AI schafft eine digitale Belegschaft. Nicht als Metapher. Als operative Realität.

Ein Agent ist zielorientiert. Er bekommt eine Aufgabe, verfolgt sie bis zum Abschluss, meldet das Ergebnis zurück. Mehrere Agenten können koordiniert zusammenarbeiten, sich Teilaufgaben zuweisen, Ergebnisse konsolidieren. Das erinnert nicht zufällig an ein Team. Es funktioniert wie eines.

Die Frage, die Führungskräfte sich stellen müssen, ist unbequem: Wenn ein System mit drei koordinierten Agenten die gleiche Recherche-Aufgabe in 20 Minuten erledigt, für die ein Team aus vier Personen bisher zwei Wochen braucht, was folgt daraus? Nicht die Frage ob, sondern die Frage wann wird diese Leistungsfähigkeit in der Organisation ankommen.

Hier wird ein Denkfehler gefährlich, den ich in vielen Strategiepapieren sehe. Man plant Agentic AI als Ergänzung. Als Werkzeug, das bestehende Teams unterstützt. In Wahrheit komprimiert die Technologie Erfahrung. Was bisher Seniorität brauchte, also die Fähigkeit, aus fragmentierten Informationen ein kohärentes Bild zu formen, kann ein gut orchestriertes Agentensystem in Teilen replizieren.

Das heißt nicht, dass Menschen überflüssig werden. Aber es heißt, dass sich die Art der benötigten Kompetenz verschiebt. Wer heute Daten zusammenträgt und aufbereitet, wird morgen Agenten konfigurieren, ihre Ergebnisse bewerten und die Ausnahmen bearbeiten, die kein Algorithmus lösen kann. Das ist kein Verlust. Es kann sogar ein Gewinn sein. Aber nur, wenn die Organisation diesen Übergang bewusst gestaltet.

Ein Framework hilft bei der Orientierung. Drei strategische Optionen stehen zur Verfügung: Repositionierung, Begrenzung und Reduktion. Repositionierung bedeutet, Beschäftigte in neue Rollen zu entwickeln, die durch Agentic AI erst entstehen. Begrenzung bedeutet, den Einsatz bewusst auf definierte Bereiche zu beschränken und die menschliche Expertise dort zu schützen, wo sie unverzichtbar bleibt. Reduktion ist die dritte Option, und sie ist ehrlich: In manchen Bereichen wird die digitale Belegschaft Kapazitäten ersetzen.

Die meisten Organisationen werden alle drei Optionen gleichzeitig brauchen. Wer nur auf eine setzt, wird entweder zu langsam oder zu rücksichtslos.

Wenn Maschinen Entscheidungen vorbereiten, die niemand mehr hinterfragt

Die dritte Veränderung ist die folgenreichste. Agentic AI kann Entscheidungen nicht nur vorbereiten. Sie kann sie in bestimmten Kontexten eigenständig treffen.

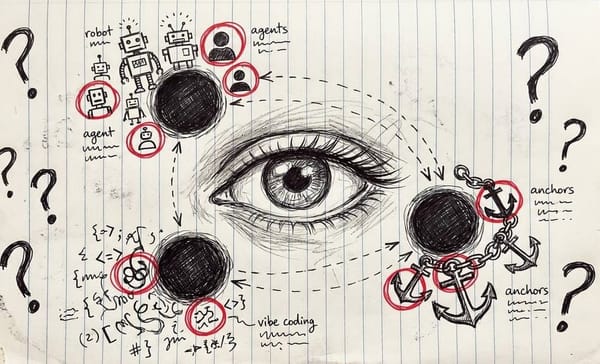

Autonomiestufen sind hier der Schlüssel. Am unteren Ende steht der beratende Agent: Er sammelt Informationen und präsentiert Optionen. Ein Mensch entscheidet. Am oberen Ende steht der vollständig autonome Agent: Er analysiert, bewertet, entscheidet und handelt. Dazwischen liegt ein breites Spektrum, und genau in diesem Spektrum spielt sich die Realität ab.

Die Versuchung ist groß, die Autonomie schrittweise hochzudrehen. Wenn der Agent bei den ersten 500 Kreditentscheidungen in 98 Prozent der Fälle richtig lag, warum dann nicht die menschliche Freigabe abschaffen? Die Antwort kennt jeder, der in einem regulierten Umfeld gearbeitet hat: Weil die 2 Prozent Fehler nicht gleichverteilt sind. Sie konzentrieren sich auf genau die Fälle, die komplex, mehrdeutig und kontextsensitiv sind. Also auf die Fälle, die über Existenzen entscheiden.

Menschliche Expertise bleibt bei diesen Entscheidungen unverzichtbar. Das ist keine nostalgische Position. Es ist eine betriebswirtschaftliche Notwendigkeit. Ein falsch positiver Treffer in einer Sicherheitsbehörde hat andere Konsequenzen als ein falsch empfohlenes Produkt in einem Online-Shop.

Was Führungskräfte jetzt brauchen, ist ein klares Governance-Modell für Entscheidungsautonomie. Nicht ein einziges Modell für die gesamte Organisation, sondern ein differenziertes: Welche Entscheidungen darf ein Agent autonom treffen? Wo muss ein Mensch freigeben? Wo darf der Agent nicht einmal empfehlen?

Aus der Praxis mit mehreren KI-Piloten in einem großen Behördenumfeld kann ich sagen: Diese Differenzierung kostet Zeit. Viel Zeit. Aber sie ist die Grundlage dafür, dass Agentic AI nicht zum Reputationsrisiko wird. Und in einem Bereich, in dem Vertrauen die härteste Währung ist, kann man sich dieses Risiko nicht leisten.

Was passiert, wenn man nicht handelt

Die drei Veränderungen, autonome Workflows, digitale Belegschaft und automatisierte Entscheidungsfindung, kommen nicht nacheinander. Sie kommen gleichzeitig. Und sie verstärken sich gegenseitig.

Ein Unternehmen, das Workflows automatisiert, braucht weniger operative Kapazität. Gleichzeitig braucht es mehr Governance-Kompetenz. Und es braucht Menschen, die verstehen, wo die Grenze zwischen sinnvoller Automatisierung und fahrlässiger Delegation verläuft.

Wer jetzt nicht handelt, verliert nicht nur Effizienz. Er verliert Handlungsfähigkeit. Denn die Organisationen, die heute ihre KI-Kompetenz aufbauen, werden morgen die Standards setzen. Und wer Standards setzt, definiert die Spielregeln.

Hierarchische Kulturen erschweren diesen Wandel besonders. Agentic AI funktioniert am besten, wenn Experimentierräume existieren. Wenn Teams Pilotprojekte starten können, ohne drei Hierarchieebenen um Erlaubnis zu fragen. Das widerspricht dem Selbstverständnis vieler Organisationen, in denen ich gearbeitet habe. Aber es ist die Realität: Bottom-Up-Innovation und Top-Down-Governance müssen koexistieren. Das ist schwer. Es ist aber machbar.

Drei Szenarien für die nächsten 36 Monate

Die Zukunft ist nicht binär. Es gibt nicht die eine KI-Zukunft, auf die man sich vorbereiten kann. Drei Szenarien sind plausibel, und eine kluge Strategie bereitet auf alle drei vor.

Im ersten Szenario entwickelt sich Agentic AI als spezialisiertes Werkzeug weiter. Agenten übernehmen klar definierte Aufgaben, bleiben aber unter menschlicher Aufsicht. Das ist die konservative Variante und wahrscheinlich die kurzfristig realistischste.

Im zweiten Szenario entsteht eine augmentierte Arbeitskultur. Menschen und Agenten arbeiten in hybriden Teams zusammen. Jeder Beschäftigte hat einen oder mehrere KI-Assistenten, die seine Arbeit verstärken. Die Organisation wird insgesamt leistungsfähiger, ohne dass massiv Stellen abgebaut werden.

Im dritten Szenario werden Agenten so leistungsfähig, dass ganze Wertschöpfungsketten ohne menschliche Beteiligung ablaufen. Das ist die disruptive Variante. Sie ist heute noch nicht Realität. Aber sie ist auch nicht mehr Science-Fiction.

Das zweite Szenario halte ich für das wahrscheinlichste. Aber wer nur auf dieses eine Szenario plant, macht denselben Fehler wie alle, die 2019 gesagt haben, dass Sprachmodelle ein Nischenthema bleiben.

Was alle drei Szenarien gemeinsam haben: Sie erfordern eine Organisation, die lernt. Nicht eine, die einmal entscheidet und dann umsetzt. Sondern eine, die ihre Strategie vierteljährlich überprüft und anpasst. KI verändert nicht nur einzelne Jobs. Sie verändert die gesamte Arbeitskultur. Und eine Kultur ändert sich nicht per Vorstandsbeschluss. Sie ändert sich durch Erfahrung, durch Reibung und durch Menschen, die bereit sind, alte Gewissheiten aufzugeben. Das ist die eigentliche Führungsaufgabe.

Von der Analyse zur Umsetzung: Was Du jetzt konkret tun kannst

Die strategische Analyse zeigt: Agentic AI ist kein Projekt, das man irgendwann starten kann. Es ist eine Transformation, die bereits läuft. Die Frage ist, ob Du sie gestaltest oder ob sie Dich gestaltet.

Vier Handlungsfelder verdienen sofortige Aufmerksamkeit.

Erstes Handlungsfeld: Governance vor Technologie. Bevor Du den ersten Agenten in Betrieb nimmst, brauchst Du ein Regelwerk. Welche Entscheidungen dürfen automatisiert werden? Wer haftet, wenn ein Agent falsch liegt? Wie wird die Nachvollziehbarkeit sichergestellt? Diese Fragen klingen bürokratisch. Sie sind es auch. Aber sie schützen Dich vor dem Moment, in dem ein autonomer Prozess eine Entscheidung trifft, die Du nicht erklären kannst.

Zweites Handlungsfeld: Kompetenzaufbau, nicht Technologiekauf. Die größte Investition ist nicht die Lizenz für eine Agentenplattform. Die größte Investition ist das Wissen Deiner Beschäftigten. Wer versteht, was ein Agent kann und was nicht, trifft bessere Entscheidungen über dessen Einsatz. Wer es nicht versteht, kauft entweder zu viel oder zu wenig. Beides ist teuer. Pilotprojekte mit klarem Lernziel sind hier der richtige Einstieg, nicht Großprojekte mit Leuchtturm-Ambitionen.

Drittes Handlungsfeld: Erfahrungswissen sichern. Wenn Agenten Routineaufgaben übernehmen, verschwindet das implizite Wissen, das in diesen Routinen steckt. Der Sachbearbeiter, der seit 15 Jahren Anträge prüft, weiß Dinge, die in keinem Handbuch stehen. Dieses Wissen muss dokumentiert werden, bevor es verloren geht. Nicht als Pflichtübung, sondern als strategische Ressource. Denn genau dieses Wissen ist es, das Agenten brauchen, um vernünftig konfiguriert zu werden.

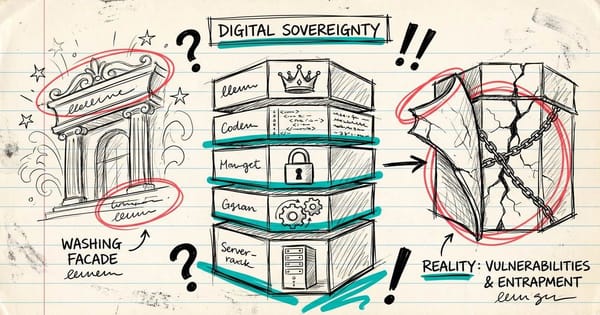

Viertes Handlungsfeld: Hybride Strategien statt Entweder-Oder. Die Versuchung ist groß, sich für ein Szenario zu entscheiden und alles darauf auszurichten. Klüger ist es, flexibel zu bleiben. Eine Multi-Modell-Architektur, die verschiedene KI-Systeme kombiniert, ist robuster als die Abhängigkeit von einem einzigen Anbieter. Techniken wie Retrieval Augmented Generation, also die gezielte Anbindung eigener Datenbestände an KI-Modelle, sichern die Faktenbasis und reduzieren Halluzinationen. Eine Personalstrategie, die sowohl Repositionierung als auch behutsame Reduktion vorsieht, ist ehrlicher als das Versprechen, dass niemand seinen Job verliert.

Was all diese Handlungsfelder verbindet: Transformation ist kein einmaliges Projekt. Es ist ein kontinuierlicher Prozess. Wer glaubt, er könne Agentic AI einmal einführen und dann zur Tagesordnung übergehen, unterschätzt die Geschwindigkeit dieser Entwicklung. Die Technologie wird sich in den nächsten 12 Monaten weiterentwickeln, und Deine Governance muss mithalten können. Das erfordert nicht nur technische Kompetenz. Es erfordert organisatorische Lernfähigkeit.

Quick Check: Ist Deine Organisation auf Agentic AI vorbereitet?

Fazit

Agentic AI ist keine Zukunftsmusik. Es ist Gegenwartsmusik, und die Melodie ändert sich schneller, als die meisten Organigramme es abbilden können. Die drei Veränderungen, autonome Workflows, digitale Belegschaft und automatisierte Entscheidungsfindung, sind nicht optional. Sie passieren. Die einzige Wahl, die Du hast, ist die zwischen Gestalten und Reagieren.

Mein Rat nach langen Jahren in Organisationen, die Veränderungen eher ertragen als begrüßen: Fang klein an, aber fang jetzt an. Bau Kompetenz auf, bevor Du Technologie kaufst. Und schreib Deine KI-Strategie selbst, bevor es die KI für Dich tut.

---

Du möchtest keine Analyse verpassen? Die Zweite Meinung als Newsletter, jeden Freitag.

Diskussionen der Mitglieder