Viele IT-Verantwortlichen nennen Sicherheit und Governance als größtes Hindernis für die unternehmensweite KI-Einführung. Gleichzeitig glauben die Mehrzahl der Beschäftigten, dass ihre Organisation sie durch KI ersetzen will. Zwei Zahlen, die dasselbe Problem beschreiben: Organisationen haben vergessen, ihre Beschäftigten auf dem Weg zum KI-Arbeitsplatz mitzunehmen. Und wer seine Leute vergisst, verliert nicht nur deren Vertrauen. Er verliert die gesamte Investition.

Wo stehen wir wirklich?

Die Ernüchterung kommt nicht überraschend. Wenige der CIOs und IT-Entscheider bewerten den eigenen Fortschritt bei KI-Projekten als gut oder sehr gut. Das bedeutet im Umkehrschluss: Fast zwei Drittel sind mit dem Status quo unzufrieden. Die Pilotprojekte laufen. Die Lizenzen sind gekauft. Die Demos haben beeindruckt. Aber die Breitenwirkung bleibt aus.

Aus der Praxis ist das Muster gut zu erkennen. Wir haben KI-Werkzeuge bereitgestellt, Schulungen organisiert, Use Cases definiert. Trotzdem lag die tägliche Nutzungsrate unter Durchschnitt. Das Problem war nicht die Technik. Das Problem war, dass die Beschäftigten nicht verstanden haben, warum sie KI nutzen sollten, wie es ihnen konkret hilft und ob ihre Arbeitsplätze sicher sind.

Der Fehler liegt im Ansatz. Die meisten KI-Einführungen folgen einem vertrauten Schema: IT beschafft, IT konfiguriert, IT schult. Was fehlt, ist der Mensch als Ausgangspunkt der Strategie. Nicht als Empfänger einer Technologie, sondern als Gestalter der eigenen Arbeitsweise.

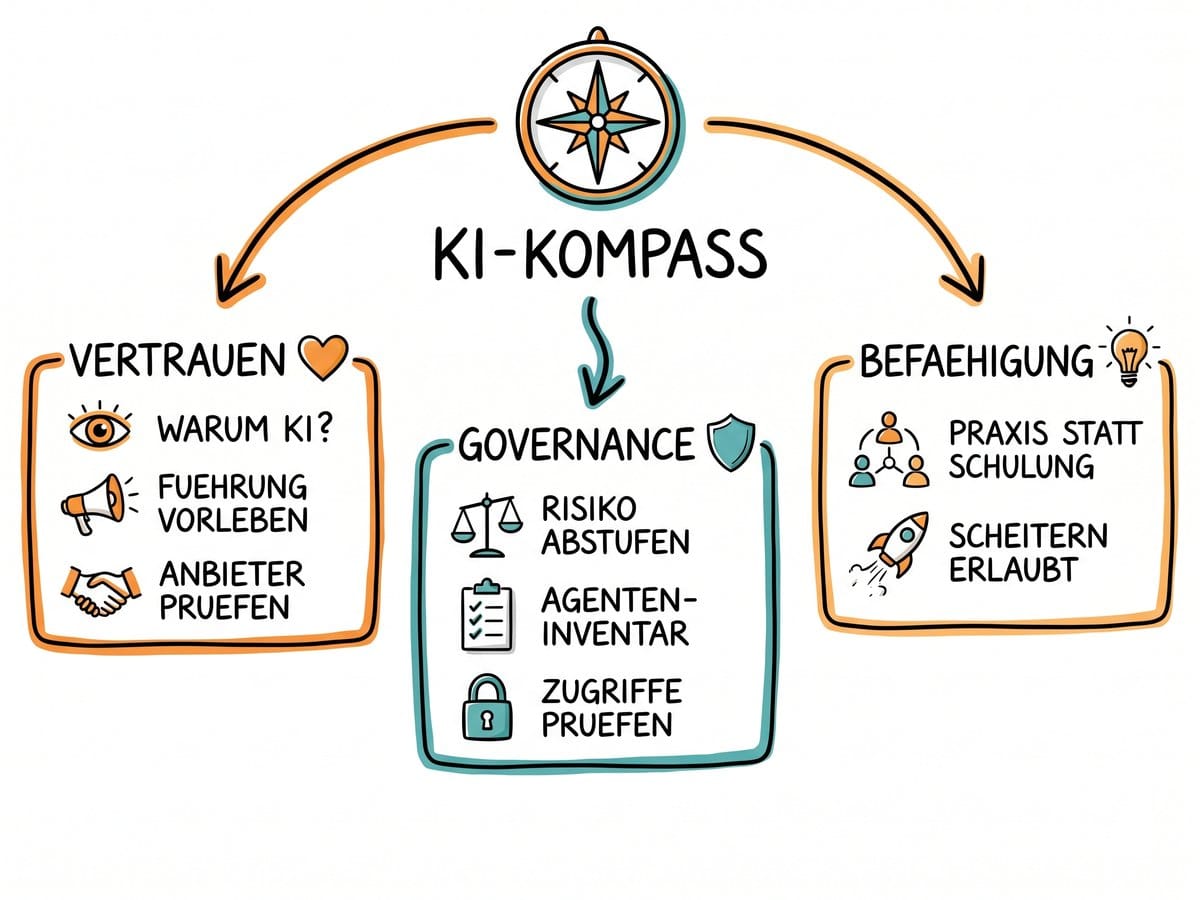

Der Kompass zeigt nach Norden: zum Menschen

Was braucht eine Organisation, die KI nicht nur einführt, sondern tatsächlich nutzt? Einen Kompass, der bei jeder Entscheidung zum Menschen zeigt. Nicht als Floskel auf Foliensatz Seite 3, sondern als operatives Prinzip.

Dieser Kompass hat drei Koordinaten: Vertrauen aufbauen, verantwortungsvoll steuern und konsequent befähigen. Die Reihenfolge ist kein Zufall. Ohne Vertrauen keine Akzeptanz. Ohne klare Regeln keine Sicherheit. Ohne Befähigung keine nachhaltige Nutzung.

Klingt logisch. In der Praxis scheitert es meistens am ersten Punkt.

Vertrauen: Die unterschätzte Währung

Viele IT-Verantwortlichen sagen, dass der Hauptdruck für KI-Einführung von der Unternehmensleitung kommt. Das ist nicht per se schlecht. Aber nur ein geringer Teil der Beschäftigten fühlen sich in Entscheidungen rund um KI einbezogen. Diese Kluft ist gefährlich.

Wenn Führungskräfte nach außen eine "KI-First"-Strategie kommunizieren und intern gleichzeitig Kostensenkung und Stellenabbau betonen, entsteht kein Vertrauen. Es entsteht Angst. Und Angst ist der zuverlässigste Killer jeder Technologieadoption.

Drei Dimensionen von Vertrauen sind dabei entscheidend. Erstens: Vertrauen der Beschäftigten in die Absichten der Organisation. Zweitens: Vertrauen zwischen den Beteiligten innerhalb der Organisation, von IT über Fachabteilungen bis zur Geschäftsführung. Drittens: Vertrauen in die Technologie selbst und ihre Anbieter.

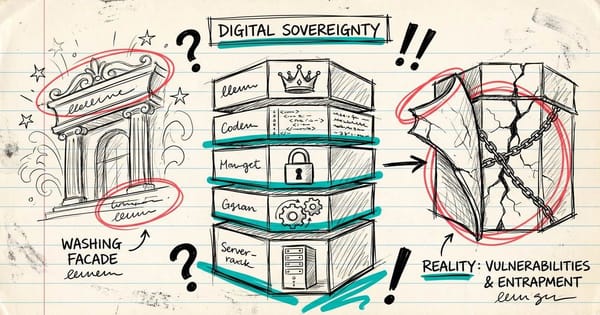

Die dritte Dimension wird in Europa zunehmend zur strategischen Frage. Ein geringer Teil der IT-Verantwortlichen vertrauen darauf, dass Anbieter ihre Produkt-Roadmaps tatsächlich umsetzen. Noch weniger vertrauen auf faire und vorhersehbare Preisgestaltung. Für Organisationen in regulierten Bereichen kommt ein weiteres Problem hinzu: Viele KI-Anbieter können die erforderliche Datenhoheit und regionale Datenverarbeitung schlicht nicht liefern, weil sie in der Entwicklung neuer Funktionen schneller sind als in der Anpassung an europäische Anforderungen.

Was bedeutet das konkret? Organisationen müssen ihre KI-Strategie bewusst selbst gestalten, statt sie vom Angebotsportfolio eines einzelnen Anbieters diktieren zu lassen. Das heißt: regionale Anbieter evaluieren, eine bewusste Multi-Anbieter-Strategie verfolgen und Beschäftigte in Anbieterentscheidungen einbeziehen. Die Frage "Wie passt dieses Werkzeug in meinen Arbeitsalltag?" wiegt schwerer als jede Benchmark auf einer Konferenzfolie.

Governance: Vom Verhinderer zum Ermöglicher

Die meisten der IT-Verantwortlichen sagen, sie brauchen bessere technische Kontrollen für KI-Governance. Die wenigsten haben das Gefühl, die richtigen internen Governance-Prozesse zu haben. Das ist eine bemerkenswerte Lücke.

Die Reaktion vieler Organisationen ist nachvollziehbar, aber falsch. Viele beschränken KI-Werkzeuge auf sogenannte "vertrauenswürdige Nutzer" oder risikoarme Anwendungsfälle. Das klingt vernünftig. In Wirklichkeit treibt es die Beschäftigten in die Schatten-KI, also in die Nutzung nicht genehmigter Werkzeuge ohne jede Kontrolle. Das Risiko steigt, statt zu sinken.

Besser wäre ein Ansatz, der Governance nicht als Blockade versteht, sondern als Leitplanke. Ein Rahmen, der Innovation ermöglicht und gleichzeitig Risiken handhabbar macht.

Vier Risiken, die jede Organisation verstehen muss

Die KI-Risikolandschaft hat sich in den letzten Monaten deutlich verändert. Vier Risiken verdienen besondere Aufmerksamkeit.

Übermäßiges Datenteilen. KI-Assistenten arbeiten mit den Daten, auf die sie Zugriff haben. Wenn die Berechtigungsstrukturen nicht stimmen, zeigen sie sensible Informationen Beschäftigten, die keinen Zugang haben sollten. Das ist kein hypothetisches Szenario. In einer Organisation, die ich begleitet habe, konnte ein eingebetteter KI-Assistent auf veraltete Projektdokumentation zugreifen und Ergebnisse liefern, die auf längst überholten Informationen basierten. Niemand hatte die Zugriffsrechte geprüft.

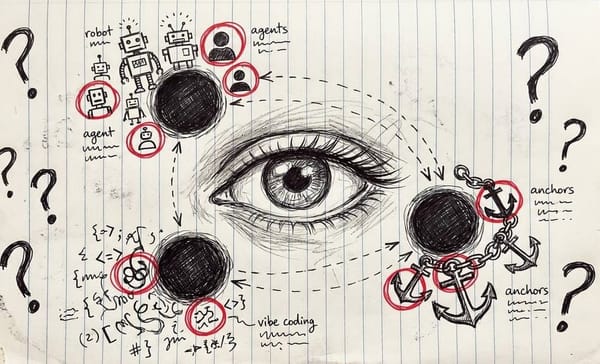

Neue Angriffsvektoren. KI-Werkzeuge und Agenten können durch Techniken wie Prompt Injection oder Data Poisoning kompromittiert werden. Besonders relevant ist das für Anwendungen, die nach außen exponiert sind, etwa auf Webseiten oder in E-Mail-Systemen.

Agenten-Wildwuchs. Jeder Anbieter baut gerade KI-Agenten in seine Produkte ein. Wenn zu viele Agenten mit zu vielen Berechtigungen entstehen und unkontrolliert geteilt werden, explodieren nicht nur die Risiken, sondern auch die Kosten.

KI-Schlacke. Große Mengen maschinell erzeugter Inhalte, die professionell aussehen, aber substanzlos sind. Sie überschwemmen interne Kanäle, untergraben Vertrauen und führen dazu, dass Beschäftigte mehr Zeit mit dem Korrigieren schlechter KI-Ergebnisse verbringen als mit produktiver Arbeit.

Das eigentliche Problem: Neue Risiken türmen sich auf, bevor die bestehenden gelöst sind. Das erzeugt bei Sicherheits- und IT-Teams das Gefühl, KI-Initiativen lieber blockieren zu müssen.

Adaptive Governance statt Einheitsbrei

Die Lösung liegt nicht in mehr Verboten, sondern in abgestufter Kontrolle. Ein KI-Agent, der nur lesend auf eine einzige interne Datenquelle zugreift und mit wenigen Personen geteilt wird, braucht andere Regeln als ein Agent, der schreibend auf mehrere Systeme zugreift und der gesamten Organisation zur Verfügung steht.

Aus meiner Erfahrung in der Praxis funktioniert das so: Jeder Agent wird bei seiner Erstellung mit einem Risikoprofil versehen. Niedrigrisiko-Agenten können von Fachabteilungen eigenständig erstellt werden. Hochrisiko-Agenten durchlaufen einen Freigabeprozess. Entscheidend ist dabei ein zentrales Inventar aller Agenten, gekoppelt mit kontinuierlichem Monitoring. Du kannst nicht steuern, was du nicht siehst.

Vier Kontrollpunkte haben sich als Praxis bewährt: ein zentrales KI-Inventar für Transparenz, ein Identitätsmanagement für Agenten, eine Informations-Governance für Datenzugriffe und ein Monitoring für Verhaltensänderungen. Kein einzelner Anbieter deckt alle vier Punkte ab. Aber wer sie als Rahmen versteht, hat eine belastbare Governance-Architektur.

Befähigung: Vom Schulungsprogramm zur KI-Fitness

Vertrauen und Governance schaffen den Rahmen. Aber ohne aktive Befähigung bleibt KI ein Werkzeug, das im Schrank liegt. Fast 40 Prozent der Beschäftigten glauben, dass KI ihren Arbeitsplatz in den nächsten fünf Jahren ersetzen könnte. Solange diese Angst nicht adressiert wird, bleibt jede Schulung wirkungslos.

Die meisten Organisationen setzen auf generische Einmalschulungen. Die Nutzung steigt kurz nach der Schulung an und fällt dann sofort wieder ab. Das Muster ist vorhersehbar, weil es den Kern des Problems ignoriert: KI ist die individuellste Technologie, die IT-Abteilungen jemals eingeführt haben. Jeder Beschäftigte nutzt sie anders, abhängig von Rolle, Kompetenz und Aufgaben.

Was stattdessen funktioniert, sind drei kulturelle Grundpfeiler.

Sicherheit zum Scheitern. Beschäftigte brauchen die Freiheit, mit KI zu experimentieren, ohne Konsequenzen zu fürchten. Das bedeutet auch: KI nicht als "digitalen Kollegen" oder "digitalen Mitarbeiter" bezeichnen. Diese Vermenschlichung löst Identitätskonflikte aus und verstärkt die Angst vor Ersetzung. KI ist ein Werkzeug. Ein mächtiges, aber eben ein Werkzeug.

Vorbildfunktion der Führung. Wenn die Führungsebene selbst keine KI nutzt oder widersprüchliche Signale sendet, folgt niemand. Führungskräfte müssen nicht nur über KI reden, sondern sie sichtbar einsetzen und den Nutzen für die eigene Arbeit kommunizieren.

Anreize statt Pflicht. KI-Nutzung zu verordnen erzeugt Minimalverhalten. Besser: Zeit für Experimente schützen, Erfolge sichtbar machen, Wissen teilen belohnen. Ein Gamification-Ansatz, bei dem Beschäftigte für absolvierte KI-Lernmodule Punkte sammeln, die sie gegen Belohnungen eintauschen können, hat in Praxisbeispielen zu einer Versiebenfachung der wöchentlichen KI-Nutzung innerhalb eines Quartals geführt.

Besonders wirksam sind KI-Praxisgemeinschaften, die sich nicht um abstrakte Technik drehen, sondern um konkrete Arbeitsprobleme. Welche Aufgabe dauert zu lang? Welcher Prozess ist zu aufwendig? Welche Routinearbeit frisst Zeit, die für Wichtigeres fehlt? Wenn KI-Lernen an reale Arbeitsprobleme gekoppelt wird, verdoppelt sich die Adoptionsrate im Vergleich zu unstrukturiertem Experimentieren.

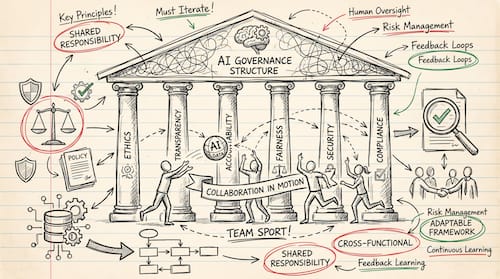

Die Zusammenarbeit der Teams ist der Schlüssel

Ein Aspekt wird in fast jeder KI-Strategie unterschätzt: Die nötigen Kompetenzen liegen in verschiedenen Teams. Die IT-Sicherheit versteht die Risiken. Die Rechtsabteilung kennt die regulatorischen Anforderungen. Die Digital-Workplace-Teams wissen, was die Beschäftigten brauchen. Aber diese Teams arbeiten selten zusammen.

In einer Organisation, in der ich diesen Ansatz begleitet habe, haben wir genau diese Silos aufgebrochen. Sicherheit, Compliance, Digital Workplace und Identitätsmanagement haben gemeinsam KI-Richtlinien entwickelt. Das Ergebnis: Richtlinien, die von allen Seiten getragen wurden und die wir mit einer Stimme kommunizieren konnten. Die Beschäftigten wussten zum ersten Mal genau, was erlaubt ist, was nicht und warum. Das hat mehr für die KI-Adoption getan als jede Schulung.

Die wenigsten der Organisationen haben diese Abstimmung zwischen Beschäftigten, IT und Führung erreicht. Aber diejenigen, die es geschafft haben, berichten über 2,4-mal höheren Nutzen aus ihren KI-Werkzeugen. Die Zahlen sind eindeutig.

Quick Check: Ist deine Organisation bereit für den KI-Arbeitsplatz?

Der Weg nach vorn

Der KI-native Arbeitsplatz ist kein Zustand, den man einmal erreicht und dann hält. Er ist ein fortlaufender Anpassungsprozess, in dem Menschen und KI-Werkzeuge zusammenarbeiten, und zwar bewusst gestaltet, nicht zufällig.

Fang nicht bei der Technologie an. Fang beim Vertrauen an. Räum die Governance-Silos auf. Und dann befähige deine Leute so, dass sie KI nicht fürchten, sondern als Werkzeug beherrschen.

Der härteste Teil ist nicht die Technik. Der härteste Teil ist, seinen eigenen Leuten zuzuhören, bevor man ihnen ein neues Werkzeug in die Hand drückt. Wer das schafft, braucht keinen Kompass mehr. Der hat die Richtung verstanden.

Diskussionen der Mitglieder