Neun verschiedene Bias-Arten können ein einziges KI-System gleichzeitig verzerren. Neun. Nicht zwei oder drei, die sich mit einem schnellen Patch beheben lassen, sondern neun systematische Fehlerquellen, die von der Datenerhebung über das Training bis zur Ausgabe an den Endnutzer wirken. Und die vier gängigen Fairness-Metriken, mit denen man diese Verzerrungen messen kann, schließen sich teilweise gegenseitig aus. Wer also glaubt, KI-Governance sei ein Compliance-Formular mit ein paar Häkchen, hat das Problem nicht verstanden. Warum behandeln so viele Organisationen KI-Governance trotzdem als reines IT-Projekt?

Warum der AI Act notwendig ist, aber nicht reicht

Der EU AI Act setzt einen regulatorischen Rahmen, der überfällig war. Risikobasierte Klassifizierung, Pflicht zur KI-Literacy, ethische Nutzungsrichtlinien, schrittweise Umsetzung mit Pilotprojekten. Das ist das Fundament. Kein vernünftiger Mensch wird dagegen argumentieren.

Aber ein Fundament ist kein Haus.

In einem großen Behördenumfeld habe ich erlebt, wie eine Organisation den AI Act pflichtbewusst umsetzte. Risikoklassen definiert, Dokumentation erstellt, Schulungsplan aufgesetzt. Auf dem Papier war alles compliant. In der Praxis fehlte ein funktionierendes Governance-Modell, das die Frage beantwortete: Wer entscheidet eigentlich was, wenn ein KI-System in Betrieb geht? Die IT-Abteilung verwies auf die Fachabteilung. Die Fachabteilung verwies auf den Datenschutzbeauftragten. Der Datenschutzbeauftragte verwies auf die Rechtsabteilung. Die Rechtsabteilung wartete auf Präzedenzfälle.

Das Ergebnis war eine Governance-Lähmung bei vollständiger regulatorischer Compliance.

Der AI Act fordert eine frühzeitige Risiko- und Impact-Analyse. Er fordert KI-Literacy. Er fordert ethische Nutzungsrichtlinien. Was er nicht liefert, ist die organisatorische Architektur, die diese Anforderungen in gelebte Praxis übersetzt. Diese Architektur muss jede Organisation selbst bauen. Und genau hier beginnt der eigentliche Teamsport.

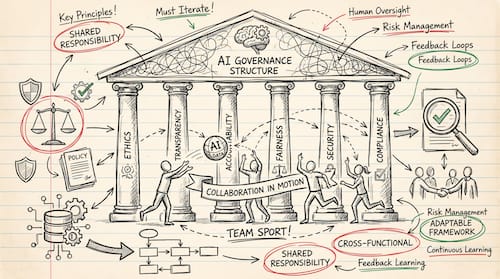

Sechs Pfeiler, ohne die nichts funktioniert

Wirksame KI-Governance ruht auf sechs Pfeilern, die sich gegenseitig bedingen. Keiner davon ist optional, und keiner funktioniert isoliert.

Verantwortlichkeit steht an erster Stelle. Nicht als abstraktes Prinzip, sondern als benannte Zuständigkeit. Wer ist verantwortlich für das Risiko eines spezifischen KI-Systems? Wer genehmigt den Einsatz? Wer zieht die Reißleine, wenn etwas schiefläuft? In vielen Organisationen bleibt diese Frage bewusst offen, weil eine klare Antwort auch klare Konsequenzen nach sich zöge.

Policy als zweiter Pfeiler meint nicht das hundertste Strategiepapier, das in der Schublade verschwindet. Gemeint ist ein operativ wirksames Regelwerk, das in den Arbeitsalltag eingreift. Das den Entwickler genauso bindet wie die Führungskraft, die ein KI-Projekt in Auftrag gibt. Eine Policy, die niemand liest, ist schlimmer als keine Policy, denn sie erzeugt eine falsche Sicherheit.

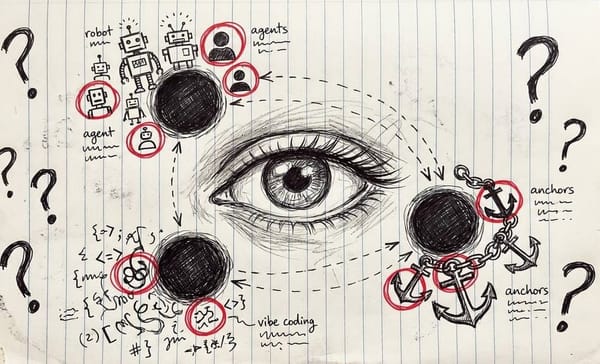

Der dritte Pfeiler ist Risikomanagement. KI-Systeme erzeugen spezifische Risiken, die sich von klassischen IT-Risiken unterscheiden. Halluzinationen bei großen Sprachmodellen, Memorisierung personenbezogener Daten, systematische Verzerrungen in Entscheidungsunterstützungssystemen. Diese Risiken erfordern spezifische Bewertungsmethoden und regelmäßige Überprüfung. Nicht einmal im Jahr, nicht bei der Einführung, sondern kontinuierlich während des gesamten Lebenszyklus.

Datenqualität als vierter Pfeiler wird oft unterschätzt, obwohl sie über Erfolg und Misserfolg entscheidet. Ohne saubere Daten ist jede KI nur ein blindes Huhn auf der Suche nach Körnern. Datenquellen müssen identifiziert, validiert und regelmäßig geprüft werden. Die Frage, ob Daten in Echtzeit oder als Batch an ein KI-System geliefert werden, ist keine technische Nebensächlichkeit. Sie bestimmt die Qualität der Ergebnisse und damit die Belastbarkeit jeder darauf aufbauenden Entscheidung. Knowledge Graphen und strukturierte Metadaten liefern den Kontext, ohne den Rohdaten oft wertlos sind. Data Lineage, also die Nachvollziehbarkeit des Weges von der Quelle bis zur Verwendung, ist kein Luxus, sondern Grundvoraussetzung für Vertrauen.

Der fünfte Pfeiler betrifft die Entwicklung. Wer KI-Systeme entwickelt oder entwickeln lässt, braucht Standards für den gesamten Prozess. Von der Anforderungsanalyse über das Training bis zum Testing. Das gilt besonders für die drei Interventionsphasen gegen Bias: Prä-Prozessierung der Trainingsdaten, In-Prozessierung während des Modelltrainings und Post-Prozessierung bei der Ergebnisausgabe. Jede Phase hat eigene Werkzeuge, eigene Limitationen, eigene Verantwortliche.

Der sechste Pfeiler ist Deployment und Betrieb. Ein KI-System, das im Labor funktioniert, kann im Produktivbetrieb völlig andere Ergebnisse liefern. Monitoring, Feedback-Schleifen, definierte Eskalationspfade und geplante Modellaktualisierungen gehören zum Betrieb wie das Ölwechseln zum Autofahren. Wer das vergisst, fährt irgendwann mit Motorschaden auf dem Seitenstreifen.

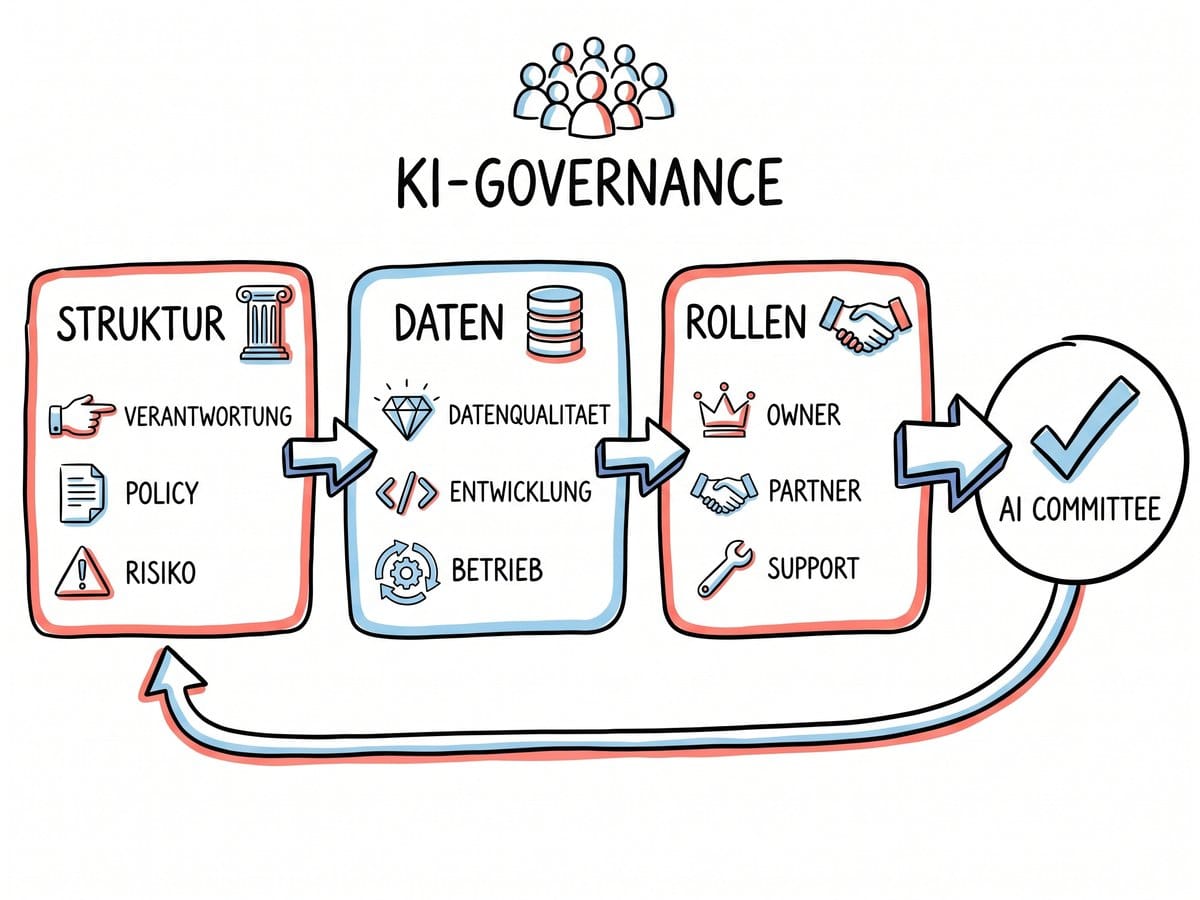

Das Drei-Stufen-Rollenmodell: Wer macht was

Alle sechs Pfeiler zusammen ergeben nichts, wenn die Verantwortlichkeiten nicht geklärt sind. Ein dreistufiges Rollenmodell hat sich in der Praxis bewährt.

Die Owner-Rolle trägt die Gesamtverantwortung für ein KI-System oder einen KI-Einsatzbereich. Das ist nicht die IT-Leitung. Das ist die Fachverantwortung, die den Nutzen definiert und die Risiken trägt. In Behörden bedeutet das: Die Abteilungsleitung, die KI für ihre Fachprozesse einsetzt, ist auch dafür verantwortlich, dass der Einsatz regelkonform und wirksam erfolgt.

Die Partner-Rolle umfasst alle Bereiche, die zur Governance beitragen, ohne selbst die Gesamtverantwortung zu tragen. Datenschutz, IT-Sicherheit, Recht, Personalvertretung, Qualitätsmanagement. Diese Bereiche liefern Expertise, Bewertungen und Freigaben. Sie haben ein Vetorecht bei kritischen Fragen, aber sie sind nicht der Engpass für jede operative Entscheidung.

Die Support-Rolle stellt Ressourcen bereit. Infrastruktur, Schulungen, Werkzeuge, Dokumentation. Ohne funktionierenden Support bleiben Owner und Partner handlungsunfähig.

In meiner langjährigen Praxis in hochregulierten Organisationen habe ich eines gelernt: Dieses Modell funktioniert nur, wenn die Rollen explizit zugewiesen und kommuniziert werden. Implizite Rollenverteilung führt zu dem Phänomen, das ich oben beschrieben habe. Alle sind irgendwie zuständig, also niemand wirklich.

Warum Du ein AI Committee brauchst

Ein Governance-Modell mit klaren Rollen braucht ein Koordinierungsgremium. Das AI Committee ist dieses Gremium. Nicht als weiteres Debattierklub-Format, sondern als Entscheidungsorgan mit echten Befugnissen.

Ein formelles Charter-Dokument legt die Prinzipien, Verantwortlichkeiten und Entscheidungsprozesse fest. Klingt bürokratisch? Ist es auch. Aber ohne diese Formalisierung passiert eines von zwei Dingen: Entweder entscheidet niemand, oder jemand entscheidet ohne Mandat. Beides endet schlecht.

Die Besetzung ist der kritischste Erfolgsfaktor. Ein AI Committee, das nur aus IT-Experten besteht, wird technisch brillante Entscheidungen treffen, die an der organisatorischen Realität scheitern. Ein Committee ohne technische Expertise wird Risiken unterschätzen oder Chancen verpassen. Interdisziplinarität ist hier kein Modewort, sondern eine funktionale Notwendigkeit. Recht, Datenschutz, Fachbereiche, IT, Personalvertretung und Führungsebene gehören an denselben Tisch.

Externe Standards wie die des National Institute of Standards and Technology oder der International Organization for Standardization stärken die Governance, weil sie einen Referenzrahmen bieten, der über die eigene Organisation hinausgeht. Wer ausschließlich interne Maßstäbe anlegt, läuft Gefahr, blinde Flecken zu institutionalisieren.

Die größte Gefahr eines AI Committee liegt allerdings in der Übersteuerung. Wenn jede KI-Anwendung durch ein mehrstufiges Genehmigungsverfahren muss, entsteht ein Flaschenhals, der Innovation erstickt. Die Kunst liegt in der Abstufung: Hochrisiko-Anwendungen erfordern volle Committee-Bewertung, Standard-Anwendungen durchlaufen einen vereinfachten Prozess, und für Experimente im Sandkasten reicht eine Anzeigepflicht.

Nach meiner Erfahrung aus mehreren KI-Piloten im öffentlichen Sektor braucht ein AI Committee vier Dinge: ein klares Mandat, eine handhabbare Sitzungsfrequenz (monatlich reicht in den meisten Fällen), einen schlanken Eskalationspfad für dringende Fälle und die Bereitschaft, Entscheidungen tatsächlich zu treffen. Das klingt selbstverständlich. Die Praxis zeigt, dass es das nicht ist.

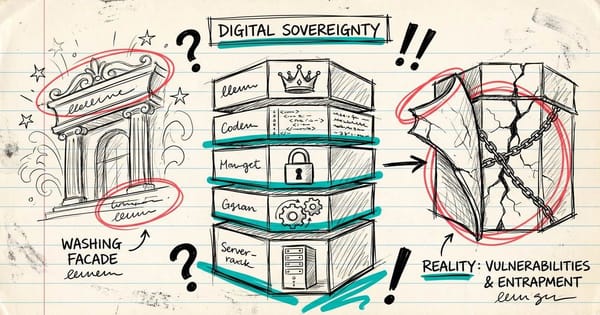

Der blinde Fleck: Drittanbieter-Management

Viele Organisationen bauen KI-Systeme nicht selbst, sondern kaufen sie ein oder nutzen Cloud-Dienste. Das verlagert die technische Verantwortung, aber nicht die Governance-Verantwortung.

Drittanbieter-Management ist der am häufigsten vernachlässigte Aspekt der KI-Governance. Welche Daten fließen an den Anbieter? Wo werden Modelle trainiert und betrieben? Welche Transparenzpflichten hat der Anbieter? Was passiert, wenn der Anbieter sein Modell ändert und sich dadurch die Ergebnisqualität verschiebt?

Besonders bei großen Sprachmodellen stellt sich die Frage der Verantwortungsdifferenzierung mit Schärfe. Die Verantwortlichkeiten zwischen Entwickler, Betreiber und Nutzer müssen klar getrennt werden. Der Entwickler verantwortet die Modellarchitektur und die Trainingsdaten. Der Betreiber verantwortet die Integration und die Absicherung gegen Missbrauch. Der Nutzer verantwortet die sachgemäße Anwendung und die Bewertung der Ergebnisse.

In der Praxis verwischt diese Dreiteilung. Wer einen Cloud-basierten KI-Dienst nutzt, ist gleichzeitig Nutzer und teilweise Betreiber. Der Black-Box-Charakter vieler KI-Systeme erschwert die Wahrnehmung von Betroffenenrechten. Wenn ein Betroffener Auskunft verlangt, welche seiner Daten ein LLM verarbeitet hat, kann der Betreiber diese Frage oft nicht beantworten. Das ist kein theoretisches Problem, sondern ein datenschutzrechtlicher Dauerbrenner.

Sicherheitsbehörden und der Sonderweg

Für Organisationen im Sicherheitsbereich kommt eine zusätzliche Dimension hinzu. Der EU AI Act nimmt Verteidigungsanwendungen explizit aus. Das bedeutet nicht, dass keine Governance nötig ist. Es bedeutet, dass eine eigene Governance-Verantwortung entsteht, die nicht auf externe Regulierung warten kann.

Drei Stakeholder-Ebenen spielen hier zusammen: die strategische Ebene, die den politischen Rahmen setzt, die operative Ebene, die KI-Systeme in Prozesse integriert, und die taktische Ebene, die mit den Ergebnissen arbeitet. Jede Ebene hat eigene Anforderungen an Vertrauenswürdigkeit und Nachvollziehbarkeit.

Die Prinzipien der Verantwortlichkeit, Transparenz und Fairness gelten auch hier. Doch sie geraten in Konflikt mit den Anforderungen der Geheimhaltung. Wie transparent kann ein KI-System sein, das in einem klassifizierten Umfeld eingesetzt wird? Wie nachvollziehbar dürfen Entscheidungswege sein, wenn die zugrunde liegenden Daten nicht offengelegt werden können?

Eine einfache Antwort existiert nicht. Aber ein praktikabler Ansatz schon: Vertrauenswürdigkeit wird in diesen Kontexten nicht durch öffentliche Transparenz hergestellt, sondern durch institutionelle Kontrolle. Unabhängige interne Prüfinstanzen, abgestufte Zugriffsrechte auf Modellbewertungen und eine dokumentierte Entscheidungshistorie, die im Bedarfsfall von autorisierten Stellen eingesehen werden kann. Das ist mühsam. Es funktioniert.

Der Faktor Mensch: Schulung und Kommunikation

Governance-Strukturen bleiben wirkungslos, wenn die Beteiligten sie nicht verstehen oder nicht unterstützen. Die Erfahrung aus über vier Jahrzehnten in der öffentlichen Verwaltung hat mich eines gelehrt: Die schönste Organisationsanweisung ist nichts wert, wenn sie nicht kommuniziert und geschult wird. Und zwar nicht in einer Rundmail mit Anlage.

KI-Literacy ist eine Pflicht, die der AI Act zurecht einfordert. Aber Literacy allein genügt nicht. Wer versteht, was ein KI-System tut, versteht noch nicht, welche Rolle er in der Governance dieses Systems spielt. Ein Kommunikationsplan muss die Governance-Rollen, Prozesse und Eskalationswege so vermitteln, dass jeder Beteiligte weiß, was er zu tun hat und warum.

Schulungen müssen zielgruppenspezifisch sein. Eine Führungskraft braucht keine Erklärung von Backpropagation, aber sie muss verstehen, warum ein KI-System diskriminieren kann und welche Fragen sie stellen muss, bevor sie eine Freigabe erteilt. Ein Fachanwender braucht keine Governance-Theorie, aber er muss wissen, wann ein Ergebnis plausibel ist und wann er eskalieren sollte. Die IT braucht beides.

Vom Papier zur Praxis: Umsetzungsempfehlungen

Wie überführst Du diese Analyse in Deine Organisation? Nicht mit einem Jahrhundertprojekt, sondern mit vier konkreten Schritten, die Du morgen beginnen kannst.

Erstens: Bestandsaufnahme der KI-Systeme. Klingt banal, ist es nicht. In vielen Organisationen weiß niemand vollständig, welche KI-Systeme im Einsatz sind. Cloud-basierte Übersetzungsdienste, KI-gestützte Suchfunktionen in Fachverfahren, automatisierte Textvorschläge in E-Mail-Programmen. All das sind KI-Systeme, die unter die Governance fallen. Ohne Inventar keine Governance.

Zweitens: Governance-Rollen zuweisen. Für jedes identifizierte KI-System oder jeden Einsatzbereich wird ein Owner benannt. Nicht die IT-Abteilung als Sammelzuständigkeit, sondern die Fachverantwortung, die den Nutzen verantwortet. Dann werden Partner und Support-Rollen zugeordnet. Das geht in einer einzigen Sitzung pro Einsatzbereich.

Drittens: AI Committee aufsetzen. Das Charter-Dokument muss keine hundert Seiten haben. Mandat, Besetzung, Sitzungsrhythmus, Entscheidungsbefugnisse, Eskalationspfad. Zwei bis drei Seiten reichen. Die erste Sitzung sollte innerhalb von vier Wochen stattfinden, nicht nach einem halben Jahr Vorbereitung.

Viertens: Data-Readiness-Check durchführen. Für jedes KI-System die Datenquellen identifizieren, Qualität bewerten, Lineage dokumentieren. Das ist aufwendig, aber ohne saubere Datenbasis baut jedes KI-Projekt auf Sand. Und auf Sand baut man keine tragfähige Governance.

Jeder dieser Schritte ist reversibel. Keiner erfordert ein Millionenbudget. Alle erfordern den Willen, KI-Governance nicht als IT-Thema zu delegieren, sondern als organisationsübergreifende Führungsaufgabe zu begreifen.

Quick Check: Ist Deine KI-Governance belastbar?

Der Appell

KI-Governance ist kein Häkchen auf einer Compliance-Checkliste. Sie ist eine Führungsaufgabe, die Disziplinen verbindet, Verantwortung zuweist und Strukturen schafft, die über den nächsten Audit-Termin hinaus Bestand haben. Der AI Act gibt Dir den regulatorischen Rahmen. Das Governance-Modell musst Du selbst bauen.

Fang an. Nicht mit dem perfekten Framework, sondern mit der ehrlichen Frage: Wer in Deiner Organisation entscheidet gerade über KI, und auf welcher Grundlage? Wenn die Antwort länger als zwei Sätze dauert, hast Du Dein erstes Governance-Problem gefunden.

Die Schule des Lebens kennt keine Ferien. KI-Governance leider auch nicht.

---

Du möchtest keine Analyse verpassen? [Die Zweite Meinung als Newsletter – jeden Freitag.]

Diskussionen der Mitglieder