Viermal mehr Budget für Fundamente als für Tools. So viel investieren Organisationen, die mit KI tatsächlich messbare Ergebnisse erzielen. Nicht doppelt so viel. Vierfach. Was, wenn dein nächstes Strategiegespräch genau an dieser Stelle die falsche Frage stellt?

Die Budgetentscheidung, die niemand so formuliert

Du kennst die Situation. Die Präsentation zum neuen KI-Vorhaben liegt auf dem Tisch. Beeindruckende Demos, ein Anbieter mit gutem Namen, ein Projektplan mit Meilensteinen. Die Frage im Raum lautet: Machen wir das? Die richtige Frage lautet anders: Haben wir die Datengrundlage, damit das überhaupt funktionieren kann?

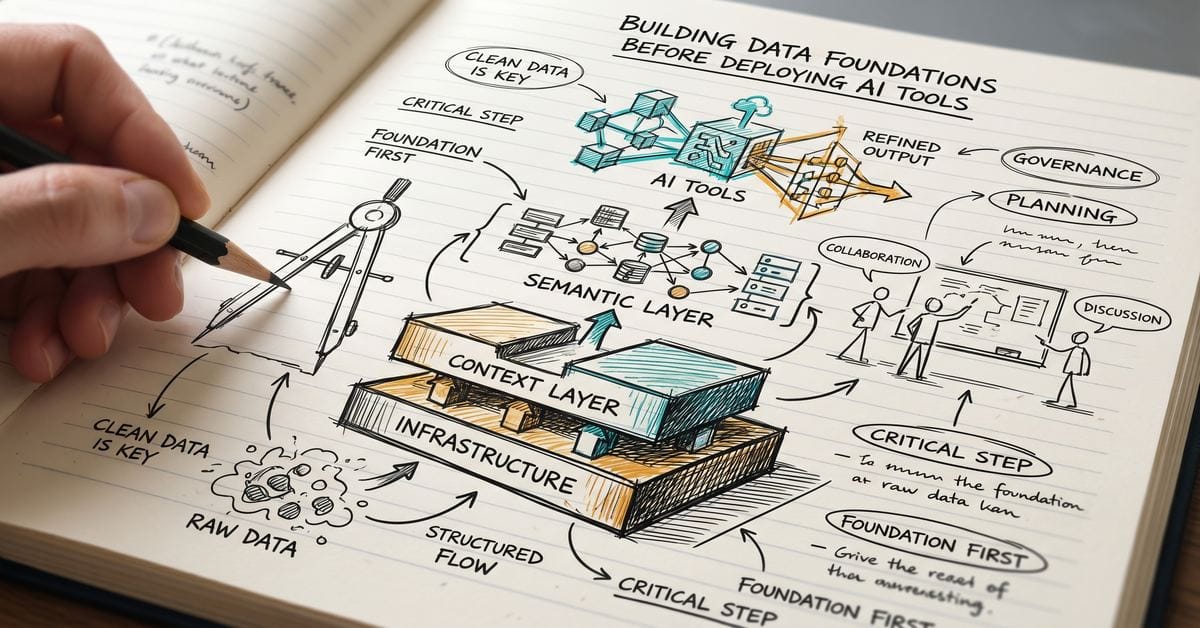

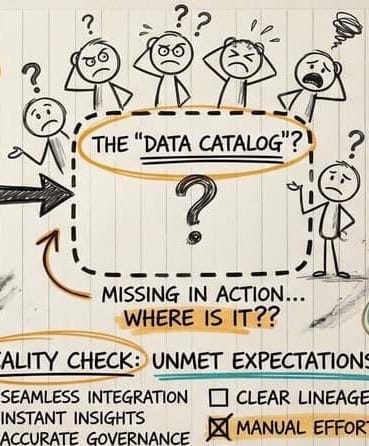

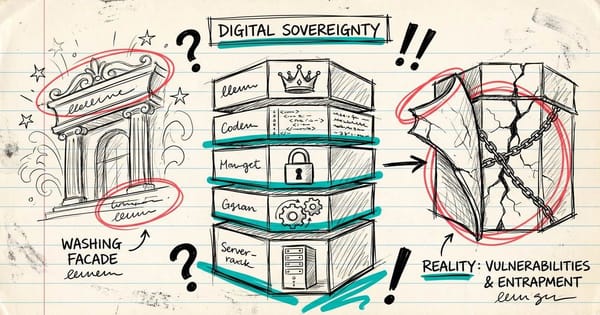

Die meisten Organisationen kaufen Analysewerkzeuge, bevor sie ihre Daten in einen Zustand gebracht haben, der Analyse überhaupt zulässt. Das klingt banal. In der Praxis bedeutet es: Millionenbudgets für Plattformen, die auf unstrukturierte, nicht gelabelte, kontextlose Datenbestände losgelassen werden. Das Ergebnis ist vorhersehbar.

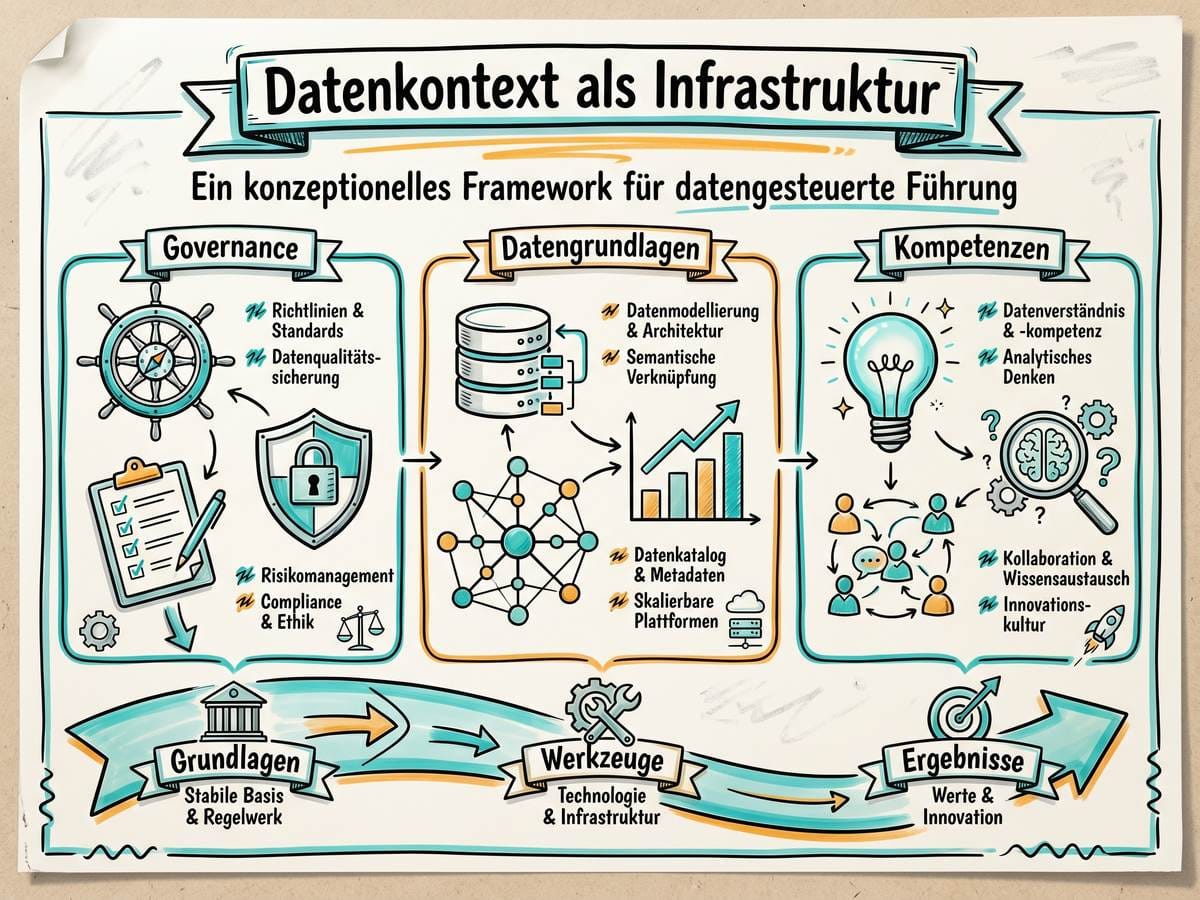

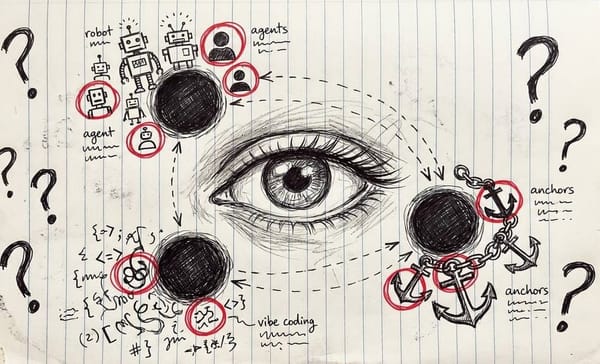

Der eigentliche Engpass ist nicht das Modell. Der Engpass ist der Kontext. Eine strukturierte Kontextschicht, bestehend aus semantischen Zuordnungen, Ontologien und maschinenlesbaren Regeln, reduziert den Rechenaufwand von KI-Systemen um den Faktor zwei bis drei. Bei gleicher oder besserer Genauigkeit. Kontext ist kein Nice-to-have. Kontext ist Infrastruktur.

Was in der Strategievorlage fehlt

Die Datenbasis-Frage geht tiefer als haben wir genug Daten? Entscheidend ist: Sind die Daten semantisch zugeordnet? Wissen Systeme, was ein Datensatz bedeutet, nicht nur wo er liegt? Ohne diese Zuordnung produziert jedes KI-System bestenfalls Rauschen, schlimmstenfalls falsche Gewissheiten.

Dann die Frage nach der Wiederverwendbarkeit. Wenn dein Datenteam für jedes neue Vorhaben die gleichen Daten neu aufbereiten muss, fehlt die Kontextschicht. Eine einmal aufgebaute semantische Infrastruktur wirkt wie ein Multiplikator: jede neue Anwendung, die darauf zugreift, muss nicht bei null anfangen.

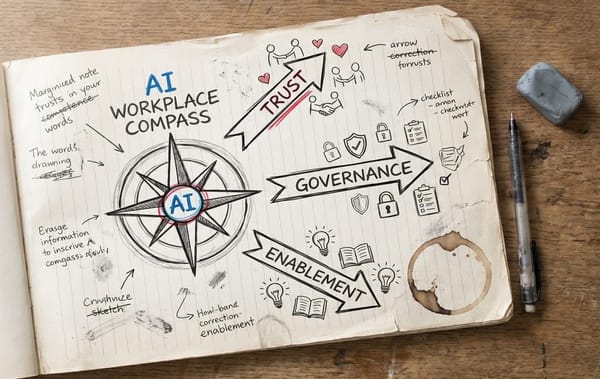

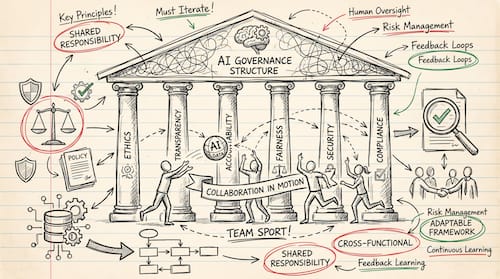

Die Governance-Frage wird gern als Compliance-Thema abgeheftet. Dabei ist sie eine Architekturfrage. Organisationen, die ihr Governance-Team aktiv in die KI-Datenbereitstellung einbinden, erzielen dreimal häufiger hohe gute Ergebnisse als solche, die Governance reaktiv betreiben. Dreimal. Governance ist kein Bremser. Governance ist Katalysator.

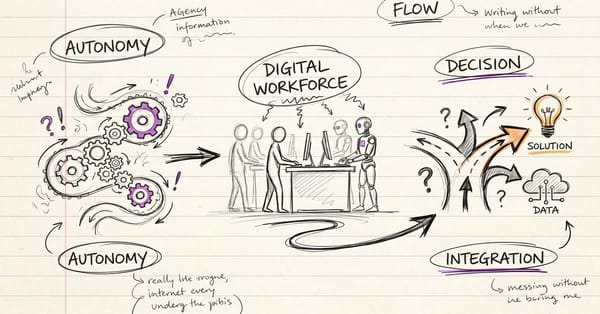

Schließlich die Kompetenzfrage. Wer betreibt diese Infrastruktur? Die Rolle verändert sich fundamental: weg vom reaktiven Datenverwalter, hin zum strategischen Schiedsrichter, der Datenqualität, Kontexttreue und Regelkonformität in Echtzeit sicherstellt. Das ist eine Führungsaufgabe, keine Stellenbeschreibung für die IT-Abteilung.

Warum Sicherheitsbehörden das zuerst verstehen

In hochregulierten Umfeldern gibt es keine Grauzone. Ohne kontextuelle und semantische Zuordnung von Einzeldaten ist eine Analyse aufgrund verfassungsrechtlicher Schranken schlicht nicht zulässig. Kein Labeling und kein Kontext, keine übergreifende und rechtlich abgesicherte Analyse. Punkt.

Das ist keine bürokratische Hürde. Das ist eine Designentscheidung, die den Rest der Architektur bestimmt. Wer hier zuerst investiert, statt auf Tool-Versprechen zu setzen, baut eine Grundlage, die jede künftige KI-Anwendung tragen kann. Wer es umgekehrt versucht, wird feststellen: Die teuerste Lizenz nützt nichts, wenn die Daten nicht in einem Zustand sind, den die Verfassung für eine Auswertung voraussetzt.

Diese Erfahrung aus dem Sicherheitsbereich ist übertragbar. Jede Organisation, die mit sensiblen Daten arbeitet, und das sind die meisten, steht vor derselben Grundsatzfrage: Investiere ich in das Werkzeug oder in das Fundament, auf dem das Werkzeug steht?

Was du in den nächsten vier Wochen tun kannst

Kontext-Audit durchführen. Nimm dein letztes KI-Vorhaben. Frag: Wie viel Prozent der Projektzeit floss in Datenaufbereitung? Wenn die Antwort über 60 Prozent liegt, fehlt die Kontextschicht.

Die Kontextschicht als Infrastruktur-Projekt deklarieren. Knowledge Graph, semantische Schicht, Policy-as-Code: Das verdient denselben Projektstatus wie Netzwerkinfrastruktur. Mit eigenem Budget, eigener Governance, eigenem Sponsor auf Vorstandsebene.

Stewardship-Rollen neu bewerten. Wer in deiner Organisation ist für die Qualität und Weiterentwicklung der Kontextschicht verantwortlich? Wenn die Antwort niemand oder die IT lautet, hast du ein Führungsproblem, kein Technikproblem.

Fazit

Die beste KI-Strategie passt auf eine Serviette: Fundamente vor Features. Kontext vor Modellen. Governance als Architektur, nicht als Audit. Alles andere ist Tool-Shopping mit Strategielabel.

Quick Check: Ist dein Fundament bereit für die KI?

Diskussionen der Mitglieder